NUEVA CÁMARA SIN LENTE UTILIZA RED NEURONAL Y TRANSFORMADOR PARA PRODUCIR IMÁGENES MÁS NÍTIDAS Y RÁPIDAS

#SLICEofDATA Tu porción diaria de Data Analytics en solo 15 minutos

Las cámaras digitales suelen necesitar objetivos para enfocar la luz entrante en un sensor de imagen. Aunque la tecnología ha mejorado continuamente, permitiendo sistemas de cámara más compactos, están limitados por la física. Un objetivo sólo puede ser tan pequeño, y la distancia entre el objetivo y el sensor tan corta. Aquí es donde entran en juego las cámaras "sin objetivo". Sin las limitaciones físicas del diseño óptico, las cámaras sin lente pueden ser mucho más pequeñas. El profesor Masahiro Yamaguchi, del Instituto Tecnológico de Tokio, coautor de un trabajo de investigación sobre un nuevo enfoque en el diseño de cámaras sin lente, afirma: "Sin las limitaciones de una lente, la cámara sin lente podría ser ultra-miniatura, lo que permitiría nuevas aplicaciones que van más allá de nuestra imaginación".

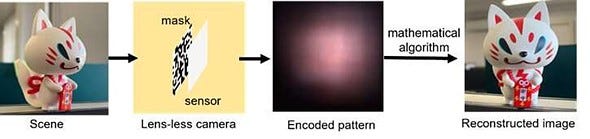

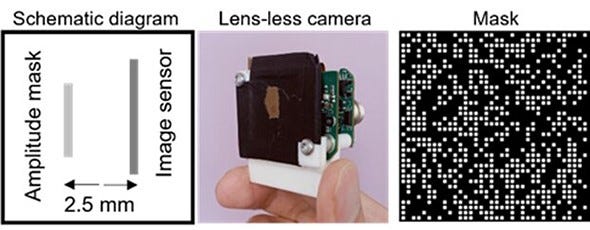

La idea de una cámara sin objetivo no es nueva. La hemos visto antes, incluyendo una cámara sin lente de un solo píxel en 2013 y, más recientemente, una cámara sin lente mucho más pequeña en 2017. Una cámara sin lente, que consta de un sensor de imagen y una fina máscara delante del sensor que codifica la información de una determinada escena, requiere una reconstrucción matemática para producir una imagen detallada. Mientras que una cámara tradicional con un objetivo óptico utiliza el cristal de su lente para enfocar y producir inmediatamente una imagen nítida, una cámara sin lente codifica la luz y debe reconstruir una imagen borrosa y desenfocada para convertirla en algo útil.

Un grupo de investigadores del Tokyo Tech, entre los que se encuentra el profesor Yamaguchi, ha creado una nueva técnica de reconstrucción que promete una mejor calidad de imagen y un procesamiento significativamente más rápido, dos cuestiones que han frenado a algunas otras cámaras sin lente.

Las anteriores cámaras sin lentes, como la desarrollada por los Laboratorios Bell en 2013 y la cámara de CalTech en 2017, se basaban en métodos para controlar la luz que incide en el sensor de imagen y realizar sofisticadas mediciones de cómo la luz interactúa con la máscara específica y física y el sensor de imagen, para luego reconstruir una imagen. Sin una forma de enfocar la luz, una cámara sin lente capta una imagen borrosa, que debe reconstruirse en una imagen más nítida mediante un algoritmo. Al entender cómo interactúa la luz con una fina máscara delante del sensor de imagen, un algoritmo puede descodificar la información de la luz y reconstruir una escena enfocada. Sin embargo, el proceso de descodificación es extremadamente difícil y requiere muchos recursos. Además de requerir tiempo, la generación de una buena calidad de imagen exige un modelo físico perfecto. Si un algoritmo se basa en una aproximación inexacta de cómo interactúa la luz con la máscara y el sensor, el sistema de la cámara fallará.

En lugar de utilizar un enfoque de decodificación basado en un modelo, el equipo de Tokyo Tech desarrolló un método de reconstrucción que se basa en el aprendizaje profundo. Los métodos de aprendizaje profundo existentes que utilizan redes neuronales convolucionales (CNN) no son lo suficientemente eficaces para resolver el problema. Como señala Phys.org, el problema es que una "CNN procesa la imagen basándose en las relaciones de los píxeles "locales" vecinos, mientras que la óptica sin lentes transforma la información local de la escena en información "global" superpuesta en todos los píxeles del sensor de imagen, a través de una propiedad llamada "multiplexación"."

La nueva investigación se basa en un novedoso algoritmo de aprendizaje automático. Se basa en una técnica llamada Vision Transformer (ViT), y promete mejorar el razonamiento global. Como escribe Phys, "la novedad del algoritmo radica en la estructura de los bloques transformadores de varias etapas con módulos "patchify" superpuestos. Esto le permite aprender eficazmente las características de la imagen en una representación jerárquica. En consecuencia, el método propuesto puede abordar bien la propiedad de multiplexación y evitar las limitaciones del aprendizaje profundo convencional basado en CNN, permitiendo una mejor reconstrucción de la imagen."

El método propuesto, que utiliza redes neuronales y un transformador conectado, promete mejorar los resultados. Además, se reducen los errores de reconstrucción y los tiempos de cálculo. El equipo cree que el método puede utilizarse para capturar imágenes de alta calidad en tiempo real, algo que no han conseguido las anteriores cámaras sin lentes.

El artículo de investigación completo, "Image reconstruction with transformer for mask-based lensless imaging", está disponible para los usuarios de pago en Optica. Los autores del artículo son Xuixi Pan, Xiao Chen, Saori Takeyama y Masahiro Yamaguchi. Puede leer el resumen a continuación. El transformador al que se hace referencia es el ViT:

A mask-based lensless camera optically encodes the scene with a thin mask and reconstructs the image afterward. The improvement of image reconstruction is one of the most important subjects in lensless imaging. Conventional model-based reconstruction approaches, which leverage knowledge of the physical system, are susceptible to imperfect system modeling. Reconstruction with a pure data-driven deep neural network (DNN) avoids this limitation, thereby having potential to provide a better reconstruction quality. However, existing pure DNN reconstruction approaches for lensless imaging do not provide a better result than model-based approaches. We reveal that the multiplexing property in lensless optics makes global features essential in understanding the optically encoded pattern. Additionally, all existing DNN reconstruction approaches apply fully convolutional networks (FCNs) which are not efficient in global feature reasoning. With this analysis, for the first time to the best of our knowledge, a fully connected neural network with a transformer for image reconstruction is proposed. The proposed architecture is better in global feature reasoning, and hence enhances the reconstruction. The superiority of the proposed architecture is verified by comparing with the model-based and FCN-based approaches in an optical experiment.

ref:

Image reconstruction with transformer for mask-based lensless imaging (optica.org)

dpreview.com - Jeremy Gray. May 2022

Tokio Institute of Technology. (Abril 2022) 'Lensless' imaging through advanced machine learning for next generation image sensing solutions. Phys.org